Tutoriel

Introduction

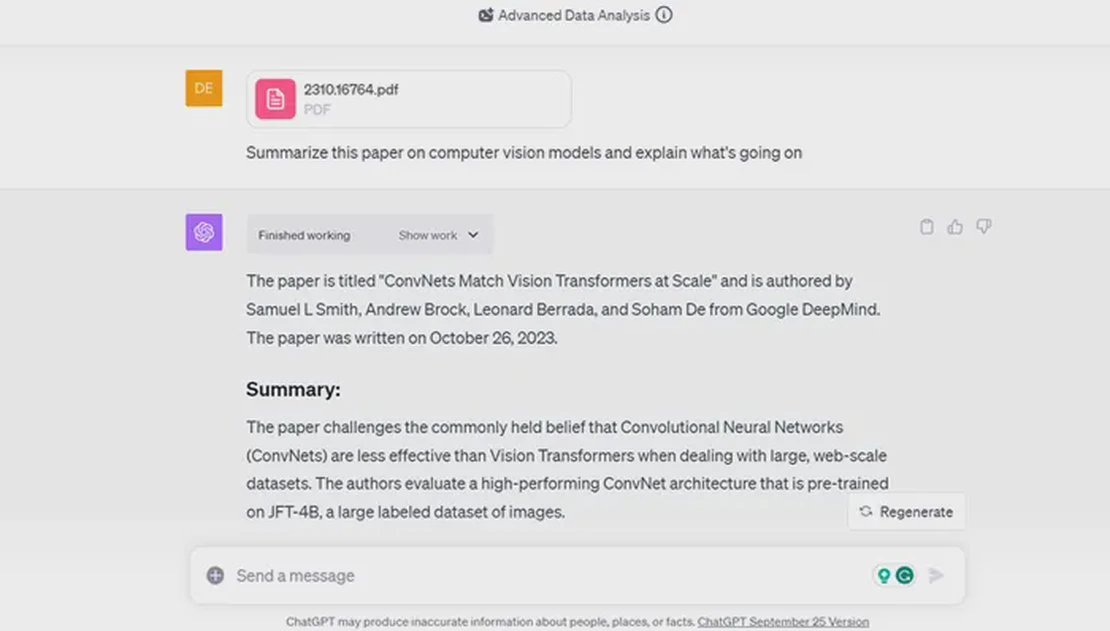

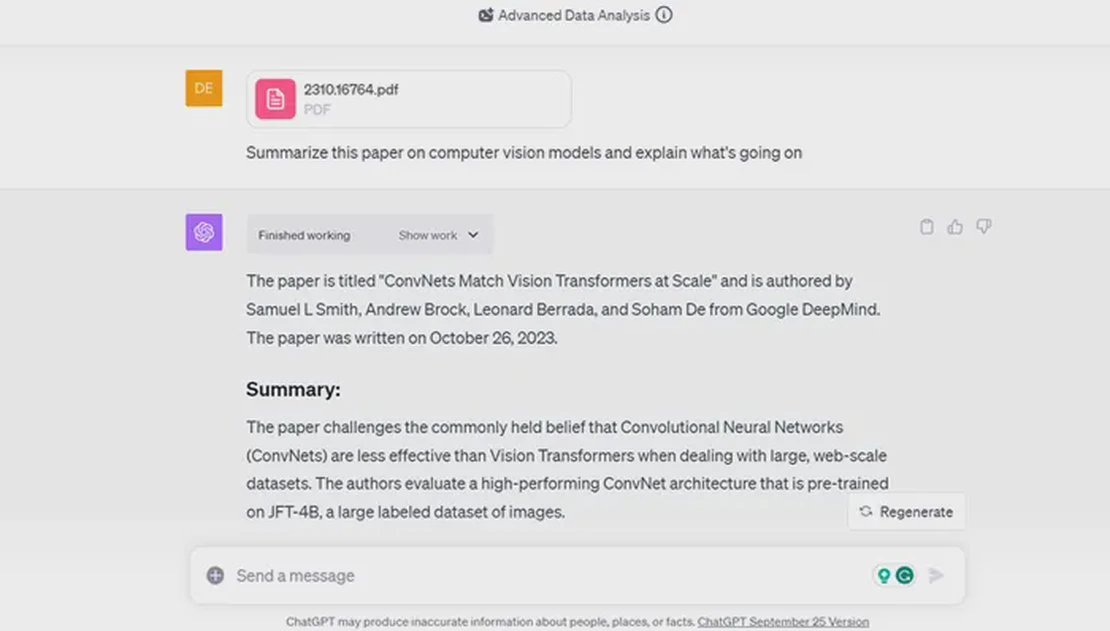

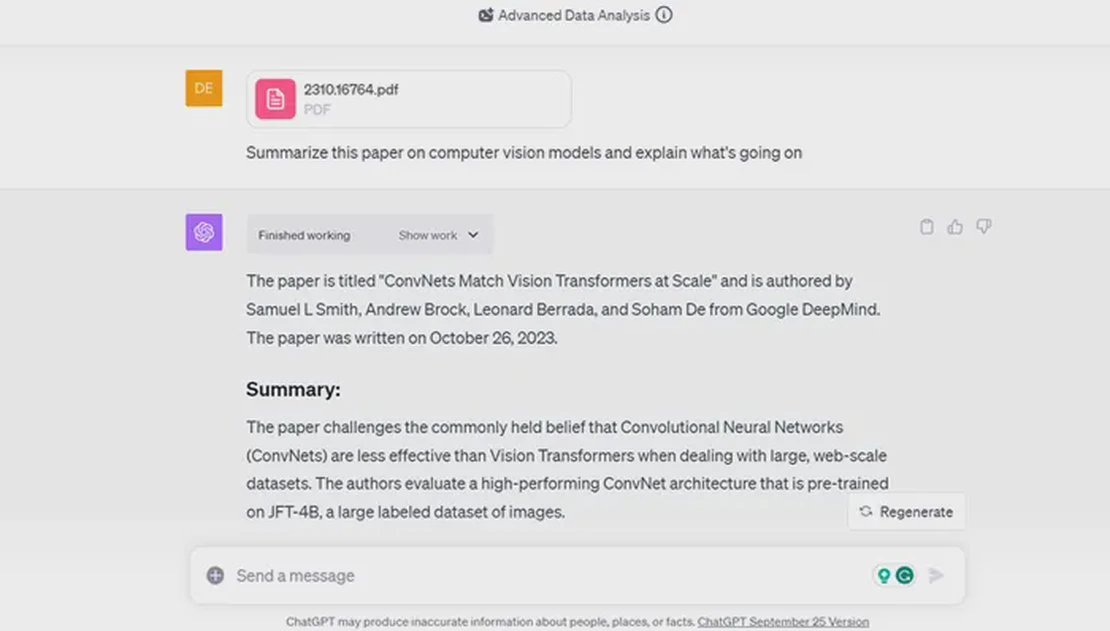

Les modèles linguistiques avancés comme ChatGPT possèdent des capacités impressionnantes en matière de génération de texte semblable à celui humain et de réponse aux questions. Cependant, il est important de comprendre que ces modèles ne possèdent qu’une connaissance générale et n’ont pas accès à des informations contextuelles spécifiques. De plus, ils sont souvent basés sur des connaissances plus anciennes, ce qui signifie qu’ils peuvent ne pas disposer des informations les plus récentes.

Introduction

Les modèles linguistiques avancés comme ChatGPT possèdent indéniablement d’impressionnantes capacités à générer du texte de type humain et à répondre aux questions. Cependant, il est crucial de comprendre que ces modèles s’appuient sur des connaissances générales et n’ont pas accès à des informations contextuelles spécifiques. De plus, ils fonctionnent souvent avec des bases de connaissances plus anciennes, ce qui signifie qu’ils peuvent ne pas avoir accès aux dernières informations.

Introduction

Les modèles linguistiques avancés comme ChatGPT possèdent indéniablement d’impressionnantes capacités à générer du texte de type humain et à répondre aux questions. Cependant, il est crucial de comprendre que ces modèles s’appuient sur des connaissances générales et n’ont pas accès à des informations contextuelles spécifiques. De plus, ils fonctionnent souvent avec des bases de connaissances plus anciennes, ce qui signifie qu’ils peuvent ne pas avoir accès aux dernières informations.

Le Problème : 75 % des entreprises interdisent ChatGPT

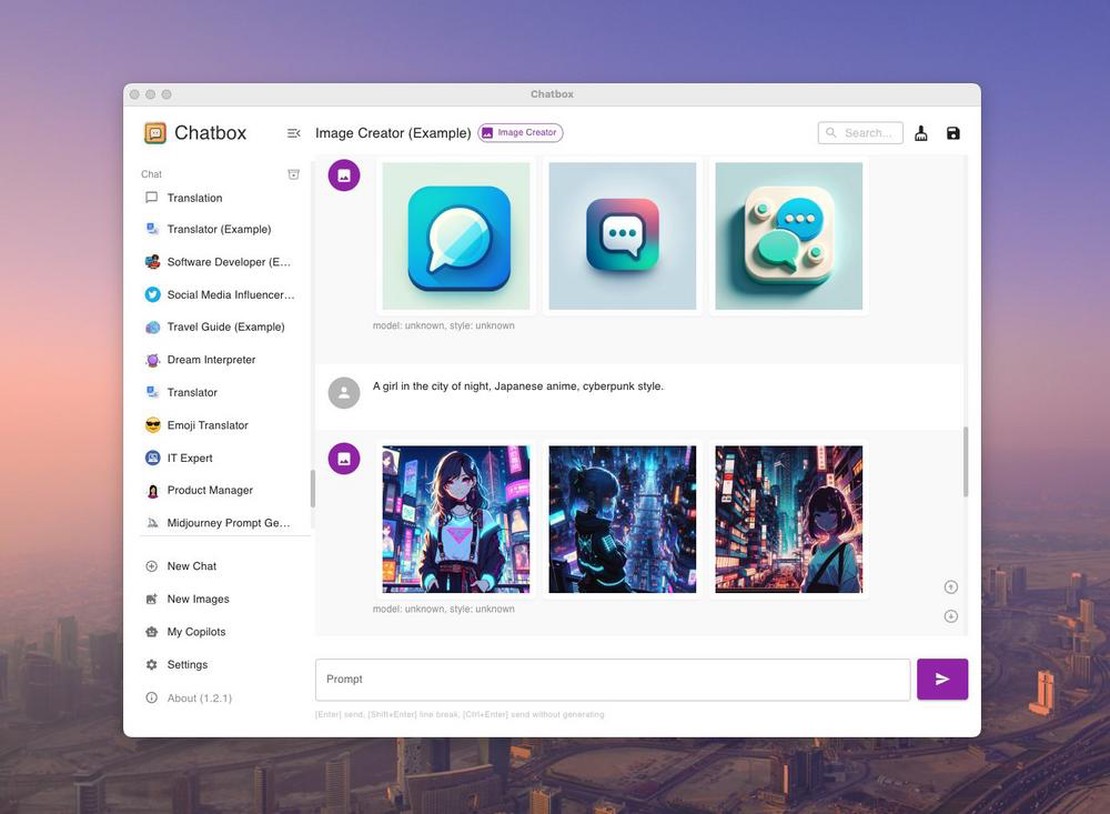

Malgré l’enthousiasme initial suscité par les outils d’IA générative comme ChatGPT, les entreprises restreignent leur utilisation en raison des préoccupations croissantes concernant la confidentialité des données et la cybersécurité. La principale inquiétude est que ces outils d’IA stockent et apprennent à partir des données utilisateur, ce qui pourrait entraîner des violations de données non intentionnelles. Bien qu’OpenAI, le développeur de ChatGPT, propose une option de désinscription de la formation avec les données utilisateur, la gestion des données au sein du système reste imprécise. De plus, il manque de réglementations juridiques claires concernant la responsabilité des violations de données causées par l’IA. Par conséquent, les entreprises hésitent et attendent que la technologie et sa réglementation évoluent.

Le Problème : 75 % des entreprises interdisent ChatGPT

Malgré l’enthousiasme initial suscité par les outils d’IA générative comme ChatGPT, les entreprises restreignent leur utilisation en raison des préoccupations croissantes concernant la confidentialité des données et la cybersécurité. La principale inquiétude est que ces outils d’IA stockent et apprennent à partir des données utilisateur, ce qui pourrait entraîner des violations de données non intentionnelles. Bien qu’OpenAI, le développeur de ChatGPT, propose une option de désinscription de la formation avec les données utilisateur, la gestion des données au sein du système reste imprécise. De plus, il manque de réglementations juridiques claires concernant la responsabilité des violations de données causées par l’IA. Par conséquent, les entreprises hésitent et attendent que la technologie et sa réglementation évoluent.

Le problème : 75 % des entreprises interdisent l’utilisation de ChatGPT

Malgré l’enthousiasme initial suscité par les outils d’IA générative tels que ChatGPT, les entreprises envisagent de restreindre leur utilisation en raison de préoccupations croissantes concernant la confidentialité des données et la sécurité informatique. La principale inquiétude réside dans le fait que ces outils d’IA stockent et apprennent à partir des données des utilisateurs, ce qui pourrait potentiellement entraîner des fuites de données non intentionnelles. Bien qu’OpenAI, le développeur de ChatGPT, propose une option de désactivation pour l’entraînement avec les données des utilisateurs, la manière dont les données sont traitées au sein du système reste incertaine. De plus, il n’existe pas de réglementations claires concernant la responsabilité en cas de violation de données causée par l’IA. Par conséquent, les entreprises sont de plus en plus prudentes et attendent de voir comment la technologie et sa réglementation évoluent.