Tutorial

Introducción

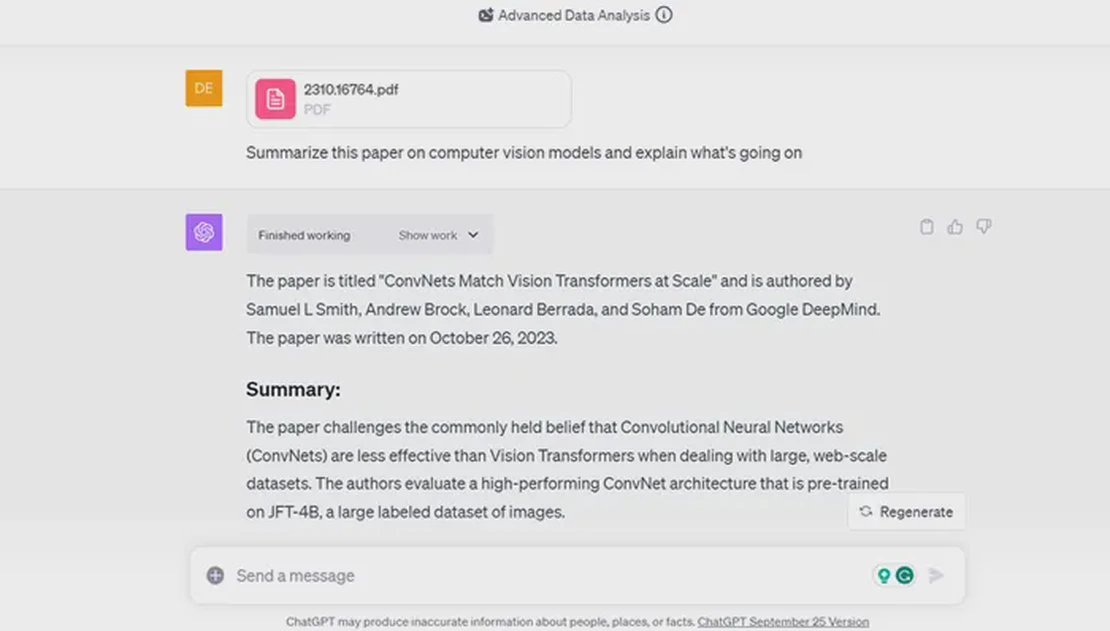

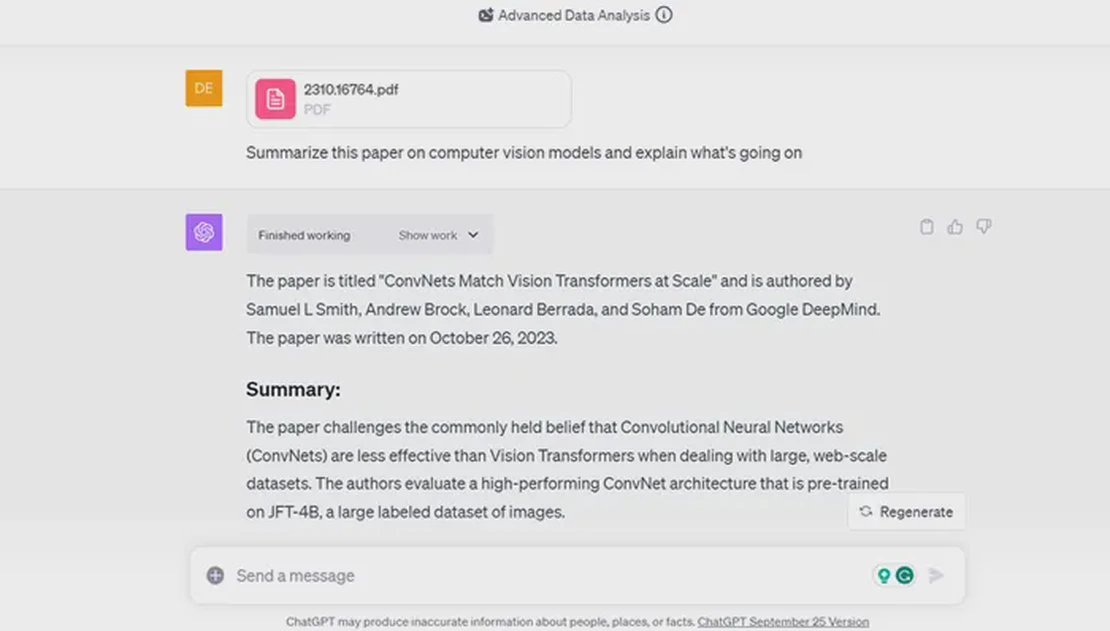

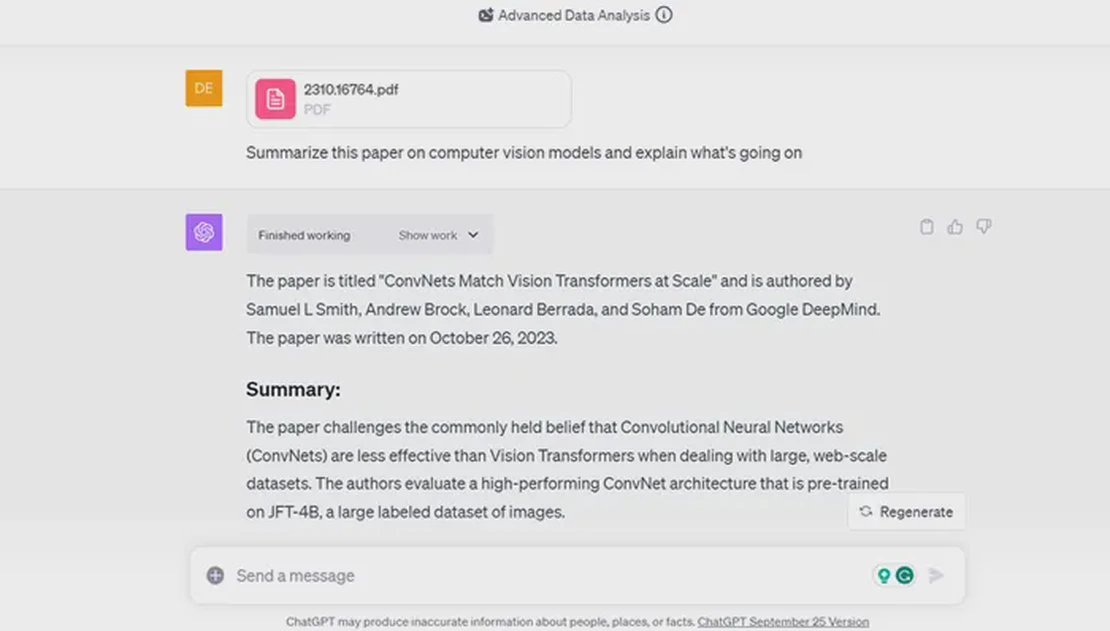

Los modelos de lenguaje avanzados como ChatGPT sin duda tienen capacidades impresionantes a la hora de generar texto similar al humano y responder preguntas. Sin embargo, es importante entender que estos modelos solo poseen conocimiento general y no tienen acceso a información específica del contexto. Además, a menudo se basan en conocimientos antiguos, lo que significa que es posible que no dispongan de la información más actualizada.

Introducción

Los modelos lingüísticos avanzados como ChatGPT poseen indudablemente capacidades impresionantes para generar texto similar al humano y responder preguntas. Sin embargo, es crucial comprender que estos modelos se basan en conocimientos generales y no tienen acceso a información específica del contexto. Además, a menudo operan con bases de conocimiento antiguas, lo que significa que podrían no tener acceso a la información más reciente.

Introducción

Los modelos lingüísticos avanzados como ChatGPT poseen indudablemente capacidades impresionantes para generar texto similar al humano y responder preguntas. Sin embargo, es crucial comprender que estos modelos se basan en conocimientos generales y no tienen acceso a información específica del contexto. Además, a menudo operan con bases de conocimiento antiguas, lo que significa que podrían no tener acceso a la información más reciente.

El problema: El 75% de las empresas prohíbe el uso de ChatGPT

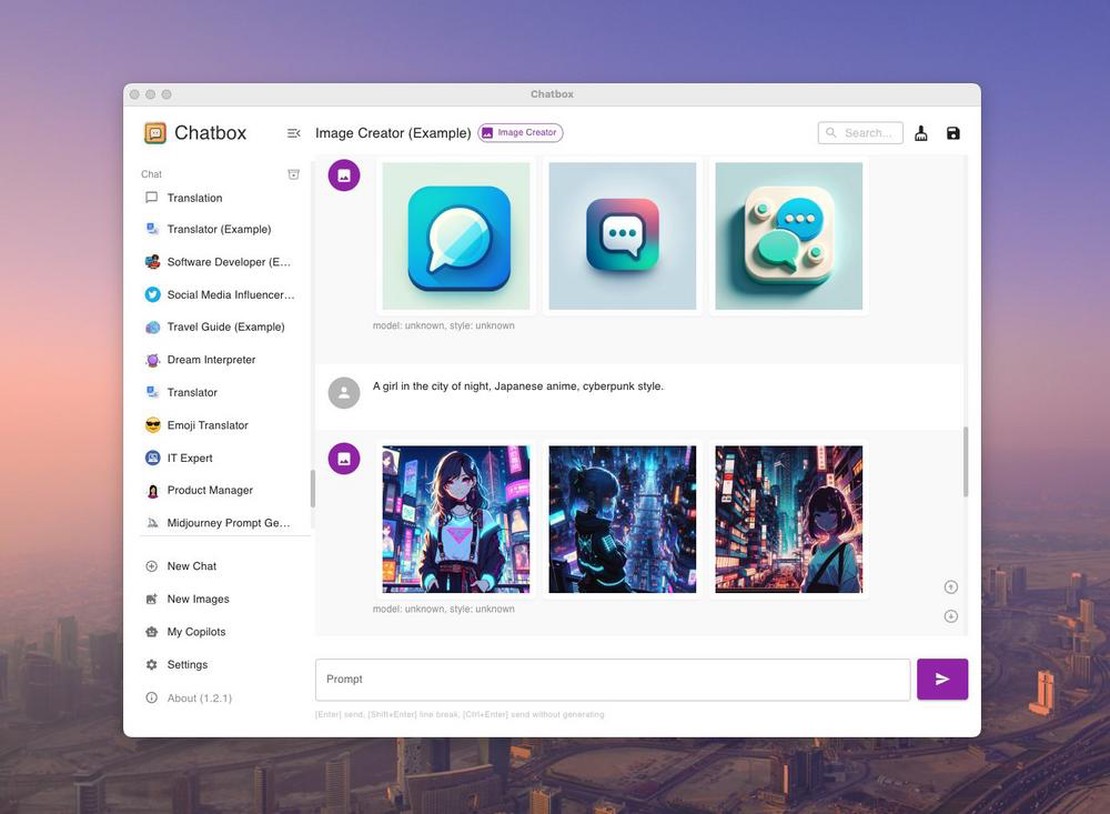

A pesar de la entusiasta acogida inicial a las herramientas de IA generativas como ChatGPT, las empresas están reconsiderando su uso debido a crecientes preocupaciones sobre la privacidad de datos y la ciberseguridad. La principal preocupación es que estas herramientas de IA almacenen y aprendan de los datos de los usuarios, lo que podría provocar filtraciones de datos no deseadas. Aunque OpenAI, el desarrollador de ChatGPT, ofrece una opción para “optar por no participar” en el entrenamiento con datos de usuarios, la forma en que se manejan los datos dentro del sistema sigue sin estar clara. Además, faltan normativas claras sobre la responsabilidad ante las violaciones de datos causadas por la IA. Por consiguiente, las empresas son cada vez más cautelosas y esperan a ver cómo evoluciona la tecnología y su regulación.

El Problema: El 75% de las Empresas Prohíbe ChatGPT

A pesar del entusiasmo inicial por las herramientas de IA generativa como ChatGPT, las empresas están restringiendo su uso debido a las crecientes preocupaciones sobre la privacidad de los datos y la ciberseguridad. La principal preocupación es que estas herramientas de IA almacenan y aprenden de los datos del usuario, lo que potencialmente puede dar lugar a violaciones de datos no deseadas. Aunque OpenAI, el desarrollador de ChatGPT, ofrece una opción para optar por no participar en el entrenamiento con datos de usuario, la gestión de los datos dentro del sistema sigue sin estar clara. Además, faltan regulaciones legales claras sobre la responsabilidad de las violaciones de datos causadas por la IA. En consecuencia, las empresas se muestran reticentes y esperan que la tecnología y su regulación evolucionen.

El Problema: El 75% de las Empresas Prohíbe ChatGPT

A pesar del entusiasmo inicial por las herramientas de IA generativa como ChatGPT, las empresas están restringiendo su uso debido a las crecientes preocupaciones sobre la privacidad de los datos y la ciberseguridad. La principal preocupación es que estas herramientas de IA almacenan y aprenden de los datos del usuario, lo que potencialmente puede dar lugar a violaciones de datos no deseadas. Aunque OpenAI, el desarrollador de ChatGPT, ofrece una opción para optar por no participar en el entrenamiento con datos de usuario, la gestión de los datos dentro del sistema sigue sin estar clara. Además, faltan regulaciones legales claras sobre la responsabilidad de las violaciones de datos causadas por la IA. En consecuencia, las empresas se muestran reticentes y esperan que la tecnología y su regulación evolucionen.